Was sagen Experten aus unterschiedlichsten Bereichen dazu?

Stellungnahme KI-Experte: Prof. Dr. Frank-Michael Schleif

Zuerst wendet sich Hubert an einen ausgewiesenen Experten auf dem Gebiet der KI. Prof. Dr. Frank-Michael Schleif ist seit 2016 an der Hochschule für angewandte Wissenschaften Würzburg-Schweinfurt für die Lehrgebiete Business Intelligence und Datenbankmanagement verantwortlich und forscht im Bereich Computational Intelligence, Maschinelles Lernen, Datenanalyse und Datenmanagement.

Hubert erhält folgende Antwort:

Guten Tag,

Aktuell sehe ich Chancen für KI-Systeme vor allem in der Verbesserung von bisher eher schlichten Vorhersage-Modellen. Man könnte die Hoffnung haben, dass wir irgendwann mal Wissen, das aktuell eher in der Form von Lexika, Wikipedia, etc. vorliegt, mit prädiktiven Modellen koppeln könnten. KI ist also vor allem dort sinnvoll und nützlich, wo Fehler mit einem geringen Risiko versehen und Vorhersagen sinnvoll automatisierbar sind - respektive ein echter Bedarf dafür besteht. Ich sehe realistisch aktuell vor allem zwei Hauptrisiken bezüglich KI. Zum einen der Energieverbrauch, den lernende Systeme haben - wir als Mensch kommen im Vergleich dazu mit dem Energieverbrauch einer Glühbirne aus. Außerdem ist bei aktuellen Systemen eine Tendenz zur massiven Datenakquise zu beobachten. Oft genug sind diese Daten nur bedingt für die Modelle verwendbar - gesammelt werden sie aber doch. Man hat dann einerseits zentrale Datensenken, die Ziele für Angriffe sein könnten, und zum anderen das Risiko, dass die Modelle falsche Vorhersagen machen, die nur schwer korrigierbar sind und konkrete Nachteile für den Einzelnen bedeuten könnten. Diese Daten können heutzutage aber auch ganz ohne Intelligenz ausgewertet und zu einer totalen Überwachung genutzt werden. Existierende Techniken sind hocheffiziente zum Teil automatisierte Signal- und Datenverarbeitungssysteme. Wenn man sich zu sehr von solchen technischen Systemen und von den Menschen dahinter abhängig macht, dann gibt es sicher Probleme. Mit KI hat das wieder wenig zu tun. Eine starke KI, die auf Basis von Daten intelligente Entscheidungen trifft, gibt es aktuell nicht. Es steht auch ernsthaft zu hinterfragen, ob die aktuelle Infrastruktur und die existierenden Modelle überhaupt in der Lage wären, intelligente Vorgänge hinreichend zu simulieren. Bisher muss man die reale Welt stark standardisieren, normieren und kontrollierbar machen, damit sich ein KI-System überhaupt dort zurecht findet. Von einem utopischen Gedanken geht also erstmal auch kein Risiko aus.

Freundliche Grüße

Frank-Michael Schleif

Stellungnahme Rechtsanwalt für IT-Recht: Chan-jo Jun

Eine ganz ähnliche Ansicht vertritt auch der Rechtsanwalt für IT-Recht Chan-jo Jun. Er betreibt eine Rechtsanwaltskanzlei für IT-Recht in Würzburg und arbeitet mit seinem Team am Einsatz von künstlicher Intelligenz zur Lösung rechtlicher Aufgaben.

Auf die Frage, welche Risiken starke KI mit sich bringen, antwortet er folgendes:

Stellungnahme Wirtschaftsinformatiker: Prof. Dr. Christian Janiesch

Prof. Dr. Christian Janiesch, Juniorprofessor für Information Management an der Universität Würzburg betont, dass KI vor allem Möglichkeiten bietet, Zusammenhänge besser zu verstehen und so in bestimmten Situationen bessere Entscheidungen zu treffen. Sie sei immer dann nützlich, wenn viele Entscheidungen getroffen werden müssen, die Menschen eventuell gar nicht alle selbst treffen möchten, z.B. sehr kleinteilige und unwichtige Entscheidungen. Sie kann aber auch bei großen oder wichtigen Entscheidungen hilfreich sein, indem sie eine „zweite“ Meinung anbietet, die eventuell andere, bisher nicht beachtete Parameter miteinbezieht, solche womöglich, die Menschen selbst gar nicht erfassen können. Janiesch betont, dass es bereits sehr enge Aufgabenbereiche gibt, in denen künstliche Intelligenz den Menschen überlegen ist, z.B. bestimmte Spiele wie Schach oder das japanische Go, aber auch bei der Auswertung von medizinischen Bildern.

Stellungnahme Medizininformatiker: Prof. Dr. Rüdiger Pryss

Prof. Dr. Rüdiger Pryss, Professor für Medizininformatik an der Universität Würzburg, widerspricht hier ein Stück weit. Der Vorteil von KI-Systemen in der Medizin liegt nicht unbedingt darin, dass die Systeme Bilder generell besser beurteilen als Ärzte. Ein gut geschulter und erfahrener Arzt sei aktuell jedem KI-System beim Stellen einer Diagnose überlegen. Ein entscheidender Vorteil der KI ist aber, dass sie nicht müde wird und so können KI-Systeme in bestimmten Aufgaben schon Beachtliches leisten. Pryss betont auch zwei weitere Punkte: Die Akzeptanz von KI würde sich stark steigern, wenn klar und transparent wird, „was die KI oder das neuronale Netz macht und rechnet“. Ein wichtiges Stichwort in diesem Kontext ist die sog. „Explainable AI“. Ein weiteres wichtiges Anliegen bei der Entwicklung von KI-Systemen ist ihm die Interdisziplinarität. Um eine gute Zusammenarbeit zwischen Mensch und KI zu ermöglichen, müssen zuerst die Expert:innen der verschiedenen Fachrichtungen gut zusammenarbeiten (Informatiker:innen, Statistiker:innen und Vertreter:innen der jeweiligen Fachrichtungen, z.B. der Medizin).

💡 Explainable AI - Was versteht man unter diesem Begriff?

- Google: Explainable AI (“XAI”) umfasst eine Reihe von Tools und Frameworks, mit deren Hilfe interpretierbare und integrative Machine Learning Modelle erstellt werden können.

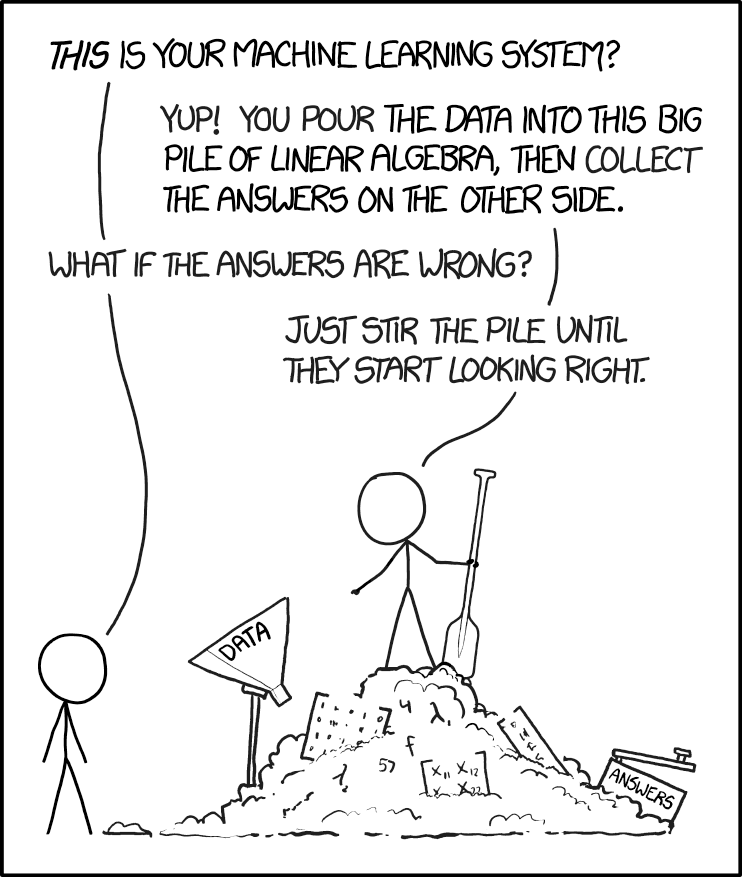

- Gesellschaft für Informatik: Das Ziel von Explainable AI ist Nachvollziehbarkeit, Verständlichkeit und Erklärbarkeit. Es ist also gewissermaßen ein Gegenentwurf zu Ansätzen, wie z.B. dem Deep Learning, sogenannten „Black-Box“ Modelle, wie sie im Cartoon dargestellt sind.

💭 Denken Sie Menschen wären künstlicher Intelligenz gegenüber aufgeschlossener, wenn der Ansatz der Explainable AI konsequenter verfolgt würde?

Stellungnahme Professor für Philosophie: Prof. Dr. Wolfgang M. Schröder

Prof. Dr. Wolfgang Schröder, Professor für Philosophie an der Universität Würzburg, geht sogar noch einen Schritt weiter. Da die tiefgreifenden Veränderungen des Wirtschafts-, Gesundheits- und Bildungssystem durch KI-basierte Automatisierung und Robotisierung (sog. posthumane maschinelle Formen) die gesamte Gesellschaft betreffen, sei für die Entwicklung zu einer „digitalen Gesellschaft“ jeder einzelne Bürger, jede einzelne Bürgerin dazu aufgefordert, sich mit den Themen zu beschäftigen (informierte Willensbildung).

Nur durch eine „aktive, gut informierte und klug vernetzte bürgerliche Öffentlichkeit“ kann eine „Fortschreibung demokratischer Selbstbestimmung der Bürger:innen im Digital Age“ gelingen. „Nur was man gemeinsam versteht, kann man gemeinsam diskutieren, verantworten und gestalten.“

Dies sei vor allem wichtig in Anbetracht der grundlegenden Ambivalenz der Entwicklungsmöglichkeiten:

- Einerseits winken bislang unerreichbare Innovationen im Dienst menschlicher Selbstverwirklichung, andererseits droht die Entwertung oder Marginalisierung bestimmter menschlicher Fähigkeiten.

- Es eröffnen sich vielfältige Chancen zur Verbesserung menschlicher Lebensbedingungen und Handlungsfähigkeit, andererseits werden menschliche Verantwortlichkeiten geschwächt.

- Einerseits eröffnen sich neue Felder gesellschaftlicher Weiterentwicklung, andererseits stellt sich die Frage der menschlichen Kontrollierbarkeit dieser Prozesse.

Aufklärung nach Immanuel Kant bedeute auch heute noch vor allem das folgende:

- Ein Appell an jeden einzelnen, Mut zum Wissen zu haben.

- Eine Warnung vor der Unmündigkeit, die entsteht, wenn man sich seines Verstandes grundsätzlich nicht mehr ohne Leitung durch andere bedienen will.