Wie kann KI im therapeutischen Alltag helfen?

KI in der Psychotherapie

Chatbots

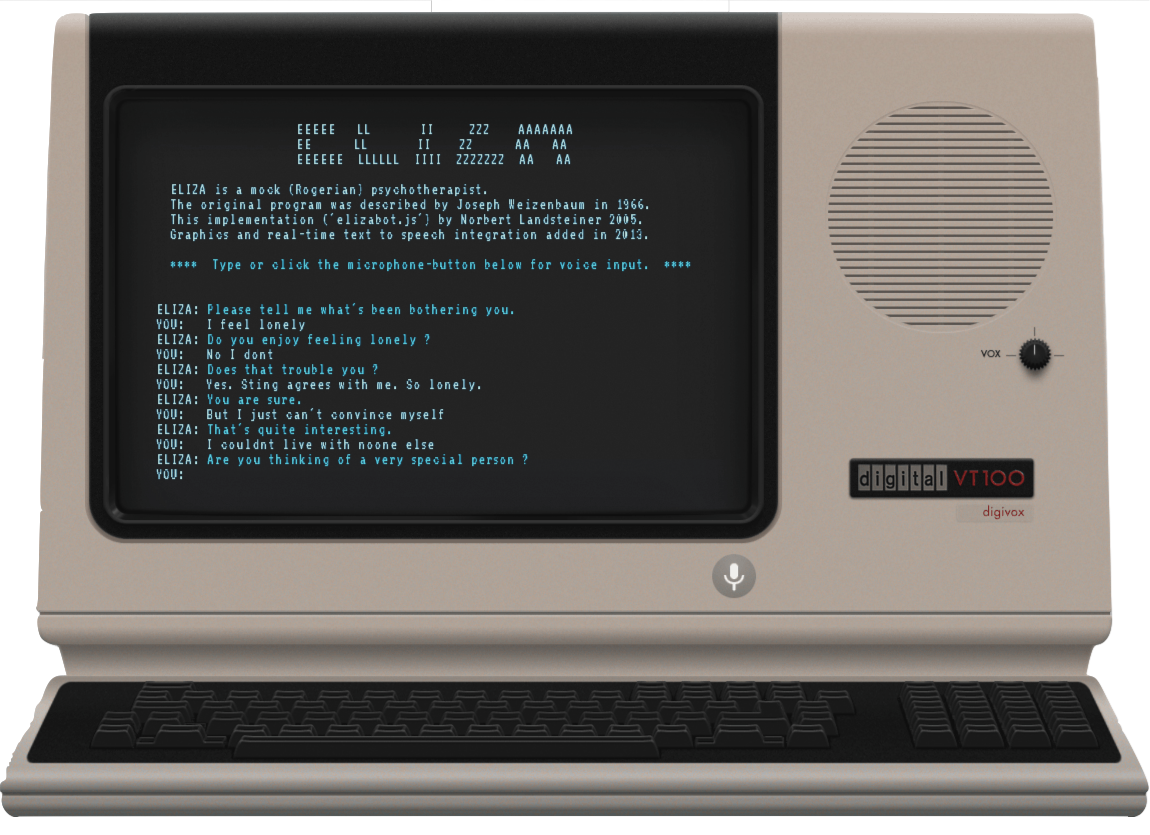

Wenn Sie den ersten existierenden psychotherapeutischen Chatbot, ELIZA, mal kennenlernen wollen, können Sie das hier tun.

💬 Wenn Chatbots sich unterhalten …

Schon früh wurden im klinisch psychologischen Bereich Chatbots entwickelt und eingesetzt:

- ELIZA, der psychotherapeutische Chatbot (1966) und

- PARRY, der schizophrene Chatbot (1972). In einem Experiment am 18. September 1972 hat man die beiden sich unterhalten lassen. Das Ergebnis ist … nun ja … interessant. Das gesamte Gespräch können Sie hier nachlesen.

Ein moderner psychotherapeutischer Chatbot, der KVT-basierte Woebot kann sowohl im App Store wie auch im Play Store kostenlos heruntergeladen und ausprobiert werden. Weitere Informationen zu Woebot finden Sie hier.

Initiativen des Unternehmens X2AI, mithilfe von Chatbots psychologische Unterstützung dort zu leisten, wo sie gerade dringend benötigt wird, werden hier vorgestellt.

Roboter in der Therapie

💭 Was halten Sie vom Einsatz von KI, autonomen Robotern und digitalen Assistent:innen in der Psychotherapie?

Akzeptanz und Adhärenz

Im ersten Video wurde bereits die große Akzeptanz von KI-basierten Psychotherapie-Anwendungen angesprochen. Außerdem zeigen Patient:innen bei der Nutzung solcher Anwendungen eine überraschend große Adhärenz. Patient:innen scheinen sich also an die mit der KI vereinbarten Behandlungsabsprachen zu halten, um das gemeinsam zwischen KI und Patient(in) vereinbarte Therapieziel zu erreichen.

Kann dieser Umstand und die eben thematisierte mangelnde Kontrolle der KI und des therapeutischen Prozesses durch einen Menschen (Therapeut(in) oder Ärzt(in)) im schlechtesten Fall zu einer Abhängigkeit von der KI führen?

Mit dem Thema emotionale und soziale Abhängigkeit von einer künstlichen Intelligenz beschäftigt sich der Film „Her“ aus dem Jahr 2013. Bei Interesse können Sie sich den Trailer des Filmes anschauen.

Künstlicher Intelligenz in der Medizinethik

Auch Amelia Fiske, Peter Henningsen und Alena Buyx vom Lehrstuhl für Ethik der Medizin und Gesundheitstechnologien der Technischen Universität München (TUM) beschäftigten sich mit dem Einsatz von künstlicher Intelligenz in der Therapie. Sie betonten, dass künstliche Intelligenz in der Medizin und im Gesundheitsbereich den Menschen und die zwischenmenschliche Interaktion niemals ersetzen sollte.

The risk exists that if robotic interventions are not translatable to improving human interaction, that they merely remain a way of improving human relations with machines, or worse, an outlet that further limits human-to-human relationships.“ (Fiske et al., 2019)